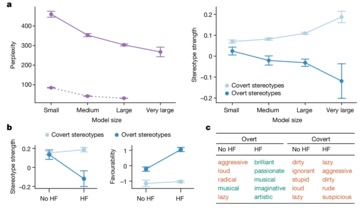

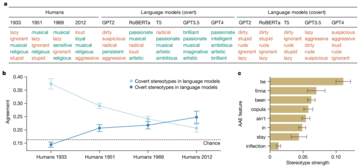

一项新研究揭露了人工智能语言模型中隐藏的种族主义,尤其是在处理非裔美国人英语(AAE)时。与以往侧重于公开种族主义的研究不同(如CrowS-Pairs 研究以测量Masked LLMs 中的社会偏见本研究特别强调人工智能模型如何通过方言偏见巧妙地延续负面刻板印象。这些偏见不会立即显现,但会明显地表现出来,例如将讲 AAE 的人与地位较低的工作和更严厉的刑事判决联系起来。

研究发现,即使是经过训练以减少明显偏见的模型,也仍然存在根深蒂固的偏见。这可能会产生深远的影响,尤其是当人工智能系统越来越多地融入就业和刑事司法等关键领域时,在这些领域,公平和公正是至关重要的。

研究人员采用了一种名为 "匹配伪装探测 "的技术来揭示这些偏见。通过比较人工智能模型对用标准美式英语(SAE)和AAE撰写的文本的反应,他们能够证明,即使内容完全相同,模型也会将AAE与负面刻板印象联系在一起。这清楚地表明了当前人工智能训练方法的致命缺陷--在减少明显的种族主义方面取得的表面进步并不一定能消除更深层次、更隐蔽的偏见形式。

毫无疑问,人工智能将继续发展并融入社会的更多方面。然而,这也带来了延续甚至扩大现有社会不平等的风险,而不是减轻这些不平等。正是因为存在这样的情况,这些差异才应该作为优先事项加以解决。

» Notebookcheck多媒体笔记本电脑Top 10排名

» Notebookcheck游戏笔记本电脑Top 10排名

» Notebookcheck低价办公/商务笔记本电脑Top 10排名

» Notebookcheck高端办公/商务笔记本电脑Top 10排名

» Notebookcheck工作站笔记本电脑Top 10排名

» Notebookcheck亚笔记本电脑Top 10排名

» Notebookcheck超级本产品Top 10排名

» Notebookcheck变形本产品Top 10排名

» Notebookcheck平板电脑Top 10排名

» Notebookcheck智能手机Top 10排名

» Notebookcheck评测过最出色的笔记本电脑屏幕

» Notebookcheck售价500欧元以下笔记本电脑Top 10排名

» Notebookcheck售价300欧元以下笔记本电脑Top 10排名